KvantiMOTV on päivitetty Kvantitatiivisen tutkimuksen verkkokäsikirjaksi. Lue uusi artikkeli Monitasomallit: Hierarkkinen lineaarinen regressio.

Hierarkkinen lineaarinen regressioanalyysi

Monitasomallin käsitteestä

Hierarkkinen aineisto

Hierarkkinen lineaarinen regressio

Miksi ryhmätason vaikutus tulee huomioida?

Ryhmätason muuttuja

Varianssin jakaminen

Kiinteitä ja satunnaisia osia

Mallin rakentaminen vaiheittain

Mallin hyvyyden arviointi

Tulosten raportointi ja tulkinta

Tilasto-ohjelmat

© Noora Ellonen (viittausohje)

Regressioanalyysi on yksi yleisimmistä monimuuttujamenetelmistä yhteiskunta-ja ihmistieteissä. Sen yleisyys johtunee siitä, että näillä tieteenaloilla ollaan varsin usein kiinnostuneita erilaisten ilmiöiden vaikutuksesta yksilöön. Regressioanalyysin erityinen etu on se, että sillä voidaan tutkia useamman muuttujan yhtäaikaista vaikutusta.

Kiinnostuksen kohteena on usein sosiaalisen ympäristön ja yksilön välinen suhde. Ollaan esimerkiksi kiinnostuneita siitä, miten työpaikan ilmapiiri vaikuttaa työssä viihtymiseen tai miten koulujen koko vaikuttaa oppilaiden oppimistuloksiin. Tutkimuskysymykset rakentuvat usein siitä näkökulmasta, että toiset kuuluvat johonkin sellaiseen ryhmään, mihin toiset eivät kuulu.

Hierarkkinen lineaarinen regressioanalyysi, kuten muutkin monitasomalleihin luettavat analyysimenetelmät, on tarkoitettu tällaisten tutkimuskysymysten ratkaisemiseen. Monitasomallien perusajatus on selittää yksilötason ilmiöitä sekä yksilötason että ryhmätason tekijöillä. Monitasoanalyysit soveltuvat siis hierarkkisten aineistojen analysointiin ja ovat siten tavallisten regressioanalyysien laajennuksia.

Monitasomallin käsitteestä

Tutkimuskirjallisuudessa monitasoisista regressioanalyyseistä käytetään eri nimityksiä. Tilastotieteellisesti orientoituneet suosivat usein sekamalli-termiä (mixed-effects tai mixed model). Yhteiskunta- ja ihmistieteissä näkee käytettävän yleistä monitasomalli-nimitystä (multilevel model), mutta kuten yksitasoisissa regressioanalyyseissä, monitasoisissakin regressioanalyyseissä erotetaan usein jo käsitteellisellä tasolla lineaariset mallit muista. Monitasoisesta lineaarisesta regressioanalyysistä käytetään muun muassa nimityksiä hierarkkinen lineaarinen malli (hierarchical linear model), satunnaiskertoimien malli (random coefficient model) ja varianssikomponenttimalli (variance component model). Lineaarisille vaste- eli selitettäville muuttujille soveltuvien mallien lisäksi monitasomalleja voidaan rakentaa muunkin tyyppisille vastemuuttujille (non-linear models ja generalized linear models). Tässä artikkelissa keskitytään kaksitasoiseen hierarkkiseen lineaariseen malliin.

Hierarkkinen aineisto

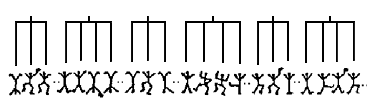

Hierarkkisella aineistolla tarkoitetaan aineistorakennetta, jossa havainnot muodostavat erilaisia ryhmiä ja jossa selittäviä tekijöitä on useammalla tasolla. Kuviossa 1 on kuvattu esimerkki kaksitasoisesta aineistosta. Kiinnostuksen kohteena olevat yksilöt muodostavat aineiston ensimmäisen tason. Yksittäiset havainnot ovat ryhmittyneet ryhmiin, jotka muodostavat aineiston toisen tason. Tyypillinen esimerkki hierarkkisesta aineistosta on koululaisista muodostuva aineisto. Alimmalla tasolla ovat oppilaat ja toisella tasolla luokat. Jos kouluja olisi useita, ne voisivat muodostaa kolmannen tason. Tasojen määrää ei periaatteessa ole rajoitettu. Tässä artikkelissa keskitytään kaksitasoiseen analyysiin.

Kuvio 1. Hierarkkinen aineistorakenne.

Hierarkkinen lineaarinen regressio

Hierarkkiset lineaariset mallit ovat tavallisen lineaarisen regression laajennuksia. Yksitasoisessa regressioanalyysissä selitetään vastemuuttujaa saman tason selittäjillä. Tavoitteena on selittää mahdollisimman suuri osa vastemuuttujan varianssista. Hierarkkisissa lineaarisissa regressiomalleissa on sama tavoite, mutta selittäjiä on vähintään kahdella tasolla. Yksilötason tekijöillä selitetään yksilötasolla olevaa vastemuuttujaa ja ryhmätason tekijöillä selitetään ryhmien välisiä eroja selittäjän ja vastemuuttujan välillä. Toisin sanoen yksitasoisessa regressioanalyysissä selitetään ilmiön vaihtelua yksilöiden välillä, kun taas sekamallissa selitetään ilmiön vaihtelua sekä yksilöiden että ryhmien välillä.

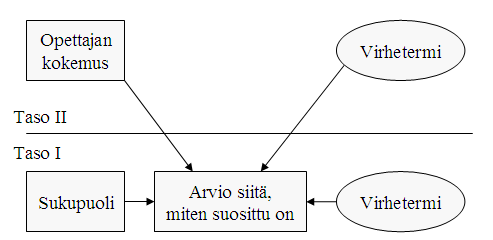

Kuviossa 2 on kuvattu artikkelin ja sen harjoituksen esimerkki kaksitasoisena tutkimusasetelmana. Selitettävä muuttuja kuvaa, kuinka suosituksi oppilaat kokevat itsensä koulussa. Tätä selitetään yksilötason muuttujalla, joka on oppilaan sukupuoli, sekä ryhmätason muuttujalla, joka on opettajan työkokemuksen pituus. Ajatuksena on, että opettajan työkokemuksen pituus lisää opettajan taitoja suhtautua oppilaisiin tasapuolisesti ja vaikuttaa oppilaiden suhtautumiseen toisiinsa, ja siten opettajan työkokemuksen pituudella voisi olla yhteys siihen, miten suosituksi oppilas kokee itsensä.

Koska analyysi on kaksitasoinen, on mallissa myös kaksi virhetermiä eli residuaalia. Alemman tason virhetermi kuvaa sitä, paljonko suosiosta jää selittymättä yksilötasolla ja ylemmän tason virhetermi sitä, paljonko suosiosta jää selittymättä koulutasolla.

Kuvio 2. Kaksitasoinen tutkimusasetelma.

Toisen tason mukaan ottaminen tuo regressiomalliin uusia parametreja. Yksitasoinen lineaarinen regressio merkitään tyypillisesti:

Yi = b0 + b1Xi + ei

jossa b0 on vakiotermi (intercept), b1 on regressiokerroin (regression slope) ja ei on virhetermi (residual error term). Vakiotermi viittaa selitettävän muuttujan arvoon silloin, kuin selittävä muuttuja saa arvon nolla, eli regressiosuora leikkaa y-akselin. Regressiokerroin on regressiosuoran kulmakerroin. Virhetermi kuvaa sitä, kuinka kaukana havainnot ovat keskimäärin regressiosuorasta, eli kuinka paljon selitettävän muuttujan vaihtelusta jää selittymättä.

Kun yksitasoisesta regressioanalyysistä tehdään kaksitasoinen, lisätään kaavaan ryhmittelevän muuttujan vaikutus. Huomioidaan siis se, että yhteys selittäjän ja vastemuuttujan välillä voi olla erilainen eri ryhmissä. Seuraavassa kaavassa on edelleen pelkästään ensimmäisen tason selittäjiä, mutta aineiston hierarkkinen rakenne on huomioitu:

Yij= b0j + b1jXij + eij

jossa b0j on vakio (intercept), b1j on regressiokerroin (regression slope) ja eij on virhetermi (residual error term).

Hierarkkisessa mallissa kukin ryhmä saa oman regressiosuoran, vakiotermin ja regressiokertoimen. Jotta yksilötaso ja ryhmätaso erottautuisivat malleissa, käytetään hierarkkisten mallien kaavamerkinnässä alanotaatioita i ja j. Alanotaatio i viittaa yksilötasoon ja j ryhmätasoon. Yksilötason virhetermiä kuvataan yksitasoiselle regressioanalyysille tyypillisillä e-termeillä. Hierarkkisessa mallissa siihen kuitenkin lisätään monitasoisuutta kuvaavat alanotaatiot, jolloin yksilötason virhetermiä merkitään termillä eij. Toisen tason virhetermeihin viitataan u-termeillä; u0j, u1j, u2j jne.

Miksi ryhmätason vaikutus tulee huomioida?

Edellä kuvattu esimerkki on varsin tyypillinen regressioanalyysiin soveltuva tutkimuskysymys: miten oppilaan sukupuoli ja opettajan työkokemus vaikuttavat siihen, miten suosituksi oppilas kokee itsensä koulussa. Miksi siihen ei voida käyttää tavallista yksitasoista lineaarista regressioanalyysiä?

Ensisijainen ongelma on se, että yksitasoisen regressioanalyysin käyttö hierarkkisessa aineistossa ei täytä yksitasoisen regressioanalyysin oletuksia. Lineaarisen regressioanalyysin perusolettamus on, että havainnot ovat toisistaan riippumattomia. Lineaarisessa regressioanalyysissä selittymättä jääneiden osien eli residuaalien, tulee olla riippumattomia, normaalisti jakautuneita ja niiden varianssien tulee olla yhtä suuret (homoskedastisuus). Hierarkkisessa aineistossa tämä olettamus ei täyty. Havainnot eivät ole riippumattomia toisistaan, sillä samaan ryhmään kuuluvat muistuttavat enemmän toisiaan kuin kaksi eri ryhmän jäsentä. Havainnot ovat ikään kuin altistuneet ryhmän samanlaistavalle vaikutukselle kiinnostuksen kohteena olevassa ilmiössä. Tämän seurauksena analyysin virhetermit eivät ole riippumattomia toisistaan ja eri havaintojen virhetermeillä voi olla erisuuruiset varianssit (heteroskedastisuus).

Toinen rajoite tavallisessa lineaarisessa regressioanalyysissä on se, että siinä ei voi käyttää selittäjiä useammalta eri tasolta. Tämä ongelma on perinteisesti ratkaistu disaggregoinnin tai aggregoinnin avulla. Disaggregoinnissa eritasoisia muuttujia muokataan siten, että niitä kaikkia voidaan tarkastella alimmalla tasolla. Aggregoinnissa sitä vastoin kaikki muuttujat muokataan soveltuviksi ylimmälle tasolle. Tämä ei kuitenkaan ratkaise riippumattomuusolettamuksen rikkomista, jolloin disaggregoidut tai aggregoidut muuttujat eivät toimi luotettavina selittäjinä. Hierarkkinen lineaarinen regressioanalyysi, kuten monitasomallit yleensäkin, ottavat huomioon aineiston klusteroitumisen, eli havaintojen riippuvuuden ryhmittäin, ja mahdollistavat myös eritasoisten selittäjien käytön.

Ryhmätason muuttuja

Jotta yksilötason ilmiötä voidaan selittää ryhmätason tekijällä, ryhmätason tekijällä tulee olla todellinen ryhmittelevä vaikutus. Analyysitasolla ryhmään kuulumisen kriteerin tulee siis olla selkeä. Kaikilla samaan ryhmään kuuluvilla tulee olla sama arvo kyseisellä muuttujalla, kaikkien havaintojen tulee kuulua johonkin ryhmään, ja ryhmien tulee olla toistensa poissulkevia. Aineiston hierarkkisuus empiirisellä tasolla tuleekin aina tarkistaa ennen mallin rakentamista.

Jotta tulokset ovat mielekkäitä, ryhmittelevän muuttujan tulee olla myös teoreettisella tasolla selkeä ja todellinen. Monissa yhteiskunta- ja ihmistieteen tutkimusasetelmissa ryhmien väliset rajat ja ryhmään kuuluminen eivät ole aina täysin yksiselitteisiä. Ryhmätason muuttujien operationalisointi tuleekin tehdä huolella ja näennäisiä ryhmittelyjä tulee välttää. Joop Hoxin teos (2010, 7) kuvaa tarkemmin monitasoisten asetelmien hahmottamista teoreettisella tasolla.

Varianssin jakaminen

Hierarkkisessa lineaarisessa mallissa on siis selittäjiä ja virhetermejä kahdella tasolla. Sen myötä mallissa on myös varianssitermejä kahdella tasolla. Virhetermeistä estimoidut eri tasojen varianssit ovat toisistaan riippumattomia. Analyysissä tarkastellaan, miten mukaan tuodut selittäjät selittävät toisaalta yksilötason varianssia ja toisaalta ryhmätason varianssia.

Varianssin kautta saadaan selville myös se, missä määrin kiinnostuksen kohteena oleva ilmiö on ylipäätään selitettävissä yksilötason tai ryhmätason ilmiöillä. Toisin sanoen varianssin jakamisen avulla voidaan tarkistaa aineiston hierarkkinen rakenne: onko ryhmätason tekijöillä merkitystä kiinnostuksen kohteena olevaan ilmiöön.

Ryhmätason vaikutuksen suuruus voidaan laskea niin sanotun sisäkorrelaation (intraclass correlation) avulla. Sisäkorrelaatiota merkitään usein rholla (ρ). Sisäkorrelaatio kuvaa, kuinka paljon varianssista on selitettävissä ylemmän tason tekijöillä. Sisäkorrelaatio lasketaan jakamalla ryhmätason varianssi ryhmätason (σ2u0) ja yksilötason (σ2e) varianssien summalla. Tulos kertoo prosentteina sen, missä määrin vastemuuttuja on selitettävissä ryhmätason ilmiöllä.

| ρ = | σ2u0 |

| σ2u0 + σ2e |

Kiinteitä ja satunnaisia osia

Hierarkkisissa lineaarisissa malleissa voidaan tarkastella sekä kiinteitä (fixed) että satunnaisia (random) vaikutuksia. Samoilla selittävillä muuttujilla voidaan siten rakentaa useita erilaisia malleja. Etukäteen on hankala usein tietää, mikä malleista on toimivin. Monitasoanalyysejä onkin hyvä rakentaa vaiheittain ja verrata erilaisia malleja keskenään.

Satunnaisuudella tarkoitetaan sitä, että annetaan satunnaisena pidettävän estimaatin vaihdella ryhmien välillä. Kiinteällä vaikutuksella tarkoitetaan sitä, että yhteys on samanlainen kaikissa ryhmissä. Erilaisia malleja nimetään usein sen mukaan, missä määrin mallissa on satunnaisia tekijöitä.

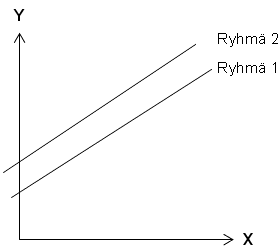

Random intercept on malli, jossa annetaan vakion vaihdella ryhmien välillä, mutta pidetään regressiokerroin kiinteänä (kuvio 3). Jokainen ryhmä saa siten oman regressiosuoransa, mutta suorat ovat samansuuntaisia ja niiden kulmakerroin on yhtä suuri. Tällöin satunnaisosa ja virhetermi u0j liittyvät vakioon, eli

b0j = γ00 + u0j

jossa γ00 on itse vakio, eli periaatteessa ryhmien yleinen keskiarvo ja u0j on sen virhetermi, joka kuvaa ryhmien välistä vaihtelua vakiossa.

Kuvio 3. Random intercept -malli.

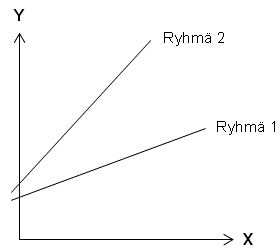

Random slope -mallista puhutaan puolestaan silloin, kun regressiokerrointen annetaan vaihdella ryhmien välillä. Jokaisen ryhmän regressiokerroin määräytyy silloin ryhmän mukaan, jonka seurauksena regressiosuorien kulmakertoimet voivat olla erilaisia ryhmien välillä (kuvio 4). Tällöin satunnaisosa ja virhetermi liittyvät regressiokertoimeen:

b1j = γ10 + u1j

jossa γ10 on vakio ja u1j sen residuaali. Mallia, jossa sekä vakion että regressiokertoimen annetaan vaihdella satunnaisesti, kutsutaan random coefficient -malliksi eli satunnaiskertoimien malliksi.

Kuvio 4. Random slope -malli

Edellisissä esimerkeissä oli mukana vain ensimmäisen tason selittäjiä. Mikäli mallissa on lisäksi toisen tason selittäjiä (Z), lisätään ne malliin seuraavasti:

b0j= γ00 + γ01Zj + u0j

jossa γ00+ γ01 ovat vakio ja regressiokerroin, jotka määrittävät vakion b0j tilanteessa, jossa ryhmätason muuttuja Z on huomioitu.

b1j= γ10 + γ11Zj + u1j

jossa γ 10 + γ11 ovat vakio ja regressiokerroin, jotka määrittävät selittävän muuttujan b1j vaikutuksen tilanteessa, jossa muuttuja Z on huomioitu.

Ryhmätason selittäjät siis selittävät joko vakion tai regressiokerrointen vaihtelua ryhmien välillä. Se, että ryhmätason muuttuja ennustaa vakiota, viittaa suoriin vaikutuksiin. Se, että ryhmätason muuttuja ennustaa regressiokertoimia, viittaa interaktiovaikutukseen tasojen välillä (cross-level interaction).

Kun otetaan huomioon selittäjät kahdelta eri tasolta, saadaan monitasomallin lausekkeeksi:

Yij= γ00 + γ10Xij + γ01Zj + γ11ZjXij + u1jXij + u0j + eij

Yhtälössä on periaatteessa kaksi osaa:

[ γ00 + γ10Xij + γ01Zj + γ11ZjXij ]

joka sisältää kaikki kiinteät kertoimet (fixed coefficients). Tätä osaa kutsutaankin usein mallin kiinteäksi osaksi.

[ u1jXij + u0j + eij ]

sisältää puolestaan kaikki satunnaiset virhetermit (random errors) ja tätä osaa kutsutaan mallin satunnaisosaksi.

Mitä enemmän mallissa on satunnaisparametreja, sitä enemmän malliin tulee myös varianssitermejä. Kuten sisäkorrelaation yhteydessä jo tuotiin esiin, ensimmäisen tason virhetermin (eij) varianssia merkitään termillä σe2 ja toisen tason virhetermin (u0j) varianssia merkitään termillä σ2u0. Satunnaisparametrien myötä mukaan tulee toisen tason u1j virhetermin varianssi, jota merkitään termillä σ2u1. Tämä varianssitermi viittaa ryhmien välisten regressiokerrointen vaihteluun. Tuomalla ryhmätason muuttujia malliin halutaan usein pienentää tätä varianssia, eli löytää syitä sille, miksi selittäjän ja vastemuuttujan välinen yhteys vaihtelee ryhmien välillä. Lisäksi mallissa on termien u0j ja u1j kovarianssi, jota merkitään termillä σu01. Tässä artikkelissa ei perehdytä kovarianssin tulkintaan, mutta se on syytä pitää aina mallissa mukana.

Mallin rakentaminen vaiheittain

Mitä enemmän mallissa on satunnaisparametreja, sitä monimutkaisemmaksi malli muodostuu. Useiden satunnaisparametrien malli voi olla hankalasti tulkittavissa. Useat satunnaisparametrit voivat joskus olla myös haaste tarkasteltaessa mallin hyvyyttä. Mallin toimivuuden ja tulkittavuuden näkökulmasta onkin kannattavaa tarkastella mallissa satunnaisvaikutuksena vain niitä muuttujia, joiden satunnaisvaikutus on merkityksellinen verrattuna vaikutuksen tarkasteluun kiinteänä. Tämän selvittämiseksi malli on syytä rakentaa vaiheittain ja verrata malleja keskenään.

Toinen syy mallin vaiheittaiselle rakentamiselle on se, että muuttujien vaikutuksia tarkastellaan usein paitsi muuttujan estimaatin avulla myös siltä kannalta, miten eri tasojen varianssit muuttuvat muuttujan tullessa malliin. Myös tämä edellyttää usein mallin vaiheittaista rakentamista.

Hierarkkisen (2-tasoisen) lineaarisen regressiomallin tyypilliset vaiheet:

- Nollamalli (intercept-only model)

- Nollamallissa malliin otetaan mukaan vain vakiotermi ja virhetermit sekä yksilö- että ryhmätasolle. Nollamallissa ei siis ole mukana selittäjiä. Nollamallilla saadaan selville, miten varianssi jakautuu yksilö- ja ryhmätasolle. Sen perusteella voidaan laskea sisäkorrelaatio.

- Lisätään ensimmäisen tason selittäjä(t)

- Ensimmäisen tason selittäjät kannattaa yleensä lisätä malliin ensin niin sanottuina kiinteinä vaikutuksina (random intercept model). Tarkastellaan muuttujien estimaatteja ja sitä, miten varianssi yksilö- ja ryhmätasolla muuttuu.

- Lisätään ryhmätason selittäjä(t)

- Lisätään malliin ryhmätason selittäjä ja tarkastellaan, paljonko sekä yksilö- että ryhmätason varianssi selittyy sillä, että otetaan toisen tason muuttujat mukaan.

- Satunnaiskertoimien malli

- Tarkastellaan yksilötason muuttujien vaikutusta satunnaisena ja verrataan, tuoko se lisäarvoa suhteessa siihen, että muuttujan vaikutusta tarkasteltaisiin kiinteänä (random slope model). Tarkastelu on hyvä tehdä erikseen kunkin selittäjän osalta.

- Cross level -interaktiomalli

- Mikäli mallissa on mukana yksilötason selittäjiä satunnaisvaikutuksena, voidaan vielä tarkastella tasojen välistä interaktiota. Tarkastellaan, selittääkö joku ryhmätason muuttuja ryhmien välisiä eroja regressiokertoimissa.

Mallin hyvyyden arviointi

Regressioanalyyseille tyypilliseen tapaan hierarkkisessa lineaarisessa mallissa pyritään selittämään mahdollisimman kattavasti vastemuuttujan varianssia. Voidaankin ajatella, että mitä enemmän malli selittää vastemuuttujan varianssista eri tasoilla, sitä parempi malli on kyseessä. Muuttujille voidaan laskea R2-selitysosuus varianssista. Sen lisäksi on kuitenkin syytä tarkastella yleisemmin sitä, miten hyvin malli istuu aineistoon, eli miten hyvin mallissa havaitut arvot vastaavat odotusarvoja.

Koska hierarkkiset mallit rakennetaan vaiheittain, tarkoittaa mallin hyvyyden arviointi käytännössä eri vaiheiden vertailua. Mallien vertailu on oma tilastollisen testauksen maailmansa, johon ei tässä paneuduta, mutta mainittakoon muutama yleisesti käytetty SPSS:n automaattisesti tulostama tunnusluku.

Yksi tapa on tarkastella -2 Log Likelihood -arvon muutosta. Mitä pienempi arvo on, sitä paremmin malli istuu aineistoon. Vaihtoehtoisesti voi käyttää AIC-informaatiokriteereitä (Akaike’s) tai BIC-informaatiokriteereitä (Schwartz’s Bayesian). Myös niiden kohdalla malli on sitä parempi, mitä pienempi arvo on. On varsin yleistä, että mallien vertailussa raportoidaan yksinomaan testisuureen arvo arvioimatta sen enempää muutoksen tilastollista merkitsevyyttä. Merkitsevyys on tarvittaessa kuitenkin laskettavissa. Esim. -2LL -testisuureen muutos noudattaa khi2-jakaumaa ja vapausasteiden määrä määräytyy lisättyjen parametrien määrästä (lue lisää Snijders & Bosker 1999).

Tulosten raportointi ja tulkinta

Vaiheittain rakennetut hierarkkiset mallit on hyvä myös raportoida vaiheittain. Eri vaiheet voidaan raportoida esimerkiksi samassa taulukossa. Seuraavassa taulukossa on raportoitu tähän artikkeliin liittyvän SPSS-harjoituksen mallit.

| Nollamalli | Kiinteiden vaikutusten malli (yksilötason muuttuja) | Kiinteiden vaikutusten malli (luokkatason muuttuja) | Satunnais-kertoimien malli | Satunnais-kertoimien malli + interaktio | |

| Kiinteä osa | |||||

| Vakio | 5.31 | 4.90 (.10) | 3.56 (.17) | 3.34 (.16) | 3.31 (.16) |

| Sukupuoli | 0.84 (.03) | 0.84 (.03) | 0.84 (.06) | 1.33 (.13) | |

| Opettajan kokemus | 0.09 (.01) | 0.11 (.01) | 0.11 (.01) | ||

| Sp*OpeKokemus | -0.03 (.01) | ||||

| Satunnainen osa | |||||

| σ2e | 0.64 (.02) | 0.46 (.01) | 0.46 (.01) | 0.39 (.01) | 0.39 (.01) |

| σ2u0 | 0.88 (.13) | 0.86 (.13) | 0.49 (.07) | 0.41 (.06) | 0.41 (.06) |

| σ2u1 | 0.27 (.05) | 0.23 (.04) | |||

| σu01 | 0.02 (.04) | 0.02 (.04) | |||

| -2LL | 5116 | 4493 | 4444 | 4276 | 4268 |

Joskus tulosten tulkinnan haasteena on se, että hierarkkisessa lineaarisessa regressioanalyysissä raportoidut kertoimet ovat standardoimattomia kertoimia. Standardoimattomat kertoimet kuvaavat sitä, paljonko selitettävä muuttuja muuttuu selittävän muuttujan muuttuessa yhden yksikön. Jos muuttujien "yksiköille" on selkeä luonnollinen tulkinta, kuten esimerkiksi vuosi, tulkinta onnistuu myös standardoimattomien kertoimien avulla. Mutta jos mallissa on mukana muuttujia, joiden "yksikkö" ei sinällään ole helposti tulkittavissa, tulisi muuttujat standardoida, eli muuttujien mittausskaala huomioida, tulkinnan helpottamiseksi. Vastaava standardoinnin tarve liittyy myös tavallisiin regressioanalyyseihin, mutta niiden kohdalla tilasto-ohjelmat laskevat standardoidut kertoimet valmiiksi. Valitettavasti yksikään yleisesti käytössä olevista tilasto-ohjelmista ei laske standardoituja kertoimia hierarkkisten mallien osalta, mutta ne voi laskea käsin. Toisissa sovelluksissa voi vaihtoehtoisesti tehdä lisäanalyysejä niiden laskemiseksi.

Toinen tulosten tulkinnassa huomioitava asia on muuttujien keskittäminen. Mielekkäimmän tulkinnan saamiseksi mallin lukuarvoille tulisi riippumattomat muuttujat keskittää (centering). Keskittämällä muuttujille saadaan merkityksellinen nollakohta, jolloin niiden tulkinta ja vertailu keskenään on mielekkäämpää. Keskittäminen on tärkeää myös yksitasoisissa regressioanalyyseissä multikollineaarisuuden eli selittävien muuttujien suuren keskinäisen korreloinnin vähentämiseksi varsinkin, jos mallissa käytetään interaktiotermejä. Muuttujien keskittämisestä monitasoanalyyseissä voi lukea lisää Endersin ja Tofighin artikkelista (2007).

Tilasto-ohjelmat

SPSS-ohjelmalla on mahdollista tehdä hierarkkisia lineaarisia malleja. Sen sijaan epälineaarisissa malleissa SPSS on vielä varsin rajallinen. Muista yleisistä tilasto-ohjelmista muun muassa Stata, R, SAS ja MPlus mahdollistavat kaikkien erilaisten monitasomallien rakentamisen. Erityisesti monitasomalleihin erikoistuneita ohjelmia ovat muun muassa MLwiN ja HLM. (Ks. linkit tilasto-ohjelmiin.)

Lähteet

Artikkeli perustuu pääasiassa kirjaan:

Hox, Joop (2010): Multilevel Analysis. Techniques and Applications. 2nd Edition. New York, Hove: Routledge.

Enders, C. K. & Tofighi, D. (2007): Centering Predictor Variables in Cross-sectional Multilevel Models: A New Look at on Old Issue. Psychological Methods 12 (2): 121-138

Snijders, T. & Bosker, R. (1999): Multilevel Analysis: An Introduction to Basic and Advanced Multilevel Modelling. 2nd Edition. Lontoo: Sage

Katso lisätiedoista muuta kirjallisuutta.